题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

关于L1、L2正则化下列说法正确的是()。

A.L2正则化能防止过拟合,提升模型的泛化能力,但L1做不到这点

B.L2正则化技术又称为LassoRegularization

C.L1正则化得到的解更加稀疏

D.L2正则化得到的解更加稀疏

如果结果不匹配,请 联系老师 获取答案

如果结果不匹配,请 联系老师 获取答案

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

A.L2正则化能防止过拟合,提升模型的泛化能力,但L1做不到这点

B.L2正则化技术又称为LassoRegularization

C.L1正则化得到的解更加稀疏

D.L2正则化得到的解更加稀疏

如果结果不匹配,请 联系老师 获取答案

如果结果不匹配,请 联系老师 获取答案

更多“关于L1、L2正则化下列说法正确的是()。”相关的问题

更多“关于L1、L2正则化下列说法正确的是()。”相关的问题

A.L2范数可以防止过拟合,提升模型的泛化能力。但L1正则做不到这一点

B.L2正则化标识各个参数的平方的和的开方值

C.L2正则化有个名称叫“Lassoregularization”

D.L1范数会使权值稀疏

A.L1范数:为x向量各个元素绝对值之和。

B.L2范数:为x向量各个元素平方和的1/2次方,L2范数又称Euclidean范数或Frobenius范数

C.L1范数可以使权值稀疏,方便特征提取

D.L2范数可以防止过拟合,提升模型的泛化能力。

A.4 cycle to local L1

B.9 cycle to local L2

C.25~33 cycle to local partition L3

D.16- 25 cycle to remote partition L3

A.Dropout背后的思想其实就是把DNN当做一个集成模型来训练,之后取所有值的平均值,而不只是训练单个DNN

B.DNN网络将Dropout率设置为p,也就是说,一个神经元被保留的概率是1-p。当一个神经元被丢弃时,无论输入或者相关的参数是什么,它的输出值就会被设置为0

C.丢弃的神经元在训练阶段,对BP算法的前向和后向阶段都没有贡献。因为这个原因,所以每一次训练,它都像是在训练一个新的网络

D.Dropout方法通常和L2正则化或者其他参数约束技术(比如MaxNorm)一起使用,来防止神经网络的过拟合

A.特征X1很可能被排除在模型之外

B.特征X1很可能还包含在模型之中

C.无法确定特征X1是否被舍

D.以上答案都不正确

A.L2、L3由总部统一分配

B.首先使用L1、L2为00(H)的号段,而L1、L2为0F(H)的号段保留备用

C.选择L1为0的连续号段

D.L4由各省自行分配

A.若正则化参数λ过大,可能会导致出现欠拟合现象

B.若λ的值太大,则梯度下降可能不收敛

C.取一个合理的λ值,可以更好的应用正则化

D.如果令λ的值很大的话,为了使CostFunction尽可能的小,所有θ的值(不包括θ0)都会在一定程度上减小

A.AA

B.A1

C.B

D.C

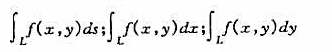

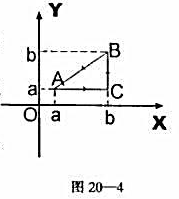

设f(x,y)为连续函数,试就如下曲线

(1)L1:连接A(a,a),C(b,a)的直线段;

(2)L2:连续A(a,a),C(b,a),B(b,b)三点的三角形(逆时针方向)

计算下列曲线积分: