题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

[多选题]

为什么RNN网络的激活函数要选用双曲正切而不是sigmod呢()。

A.使用sigmod函数容易出现梯度消失

B.sigmod的导数形式较为复杂

C.双曲正切更简单

D.sigmoid函数实现较为复杂

查看答案

如果结果不匹配,请 联系老师 获取答案

如果结果不匹配,请 联系老师 获取答案

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

A.使用sigmod函数容易出现梯度消失

B.sigmod的导数形式较为复杂

C.双曲正切更简单

D.sigmoid函数实现较为复杂

如果结果不匹配,请 联系老师 获取答案

如果结果不匹配,请 联系老师 获取答案

更多“为什么RNN网络的激活函数要选用双曲正切而不是sigmod呢…”相关的问题

更多“为什么RNN网络的激活函数要选用双曲正切而不是sigmod呢…”相关的问题

A.它包括线弹性材料模型、正切型材料模型、双曲正切型材料模型、三次非线性材料模型和更为一般的非线性缓冲材料模型

B.正切型材料模型属于线性缓冲材料模型

C.双曲正切型材料模型属于非线性缓冲材料模型

D.弹性材料模型属于线性缓冲材料模型;

A.ReLU的单侧抑制提供了网络的稀疏表达能力。

B.ReLU在其训练过程中会导致神经元死亡的问题。

C.从计算的角度上,Sigmoid和Tanh激活函数均需要计算指数,复杂度高,而ReLU只需要一个阈值即可得到激活值。

A.反向传播只能在前馈神经网络中运用

B.反向传播会经过激活函数

C.反向传播可以结合梯度下降算法更新网络权重

D.反向传播指的是误差通过网络反向传播

A.使用增加训练次数的方法不一定可以减少代价函数的取值

B.神经网络权重的初始化大小会对网络的训练结果无影响

C.对神经网络训练的优化需要综合考虑激活函数、网络结构、权重更新方法等多种因素

D.分析问题确定后,神经网络合适的结构就可以确定

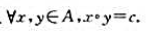

设A={a,b,c},○为A上的二元运算,且

(1)找出A上所有的双射函数.

(2)说明这些函数是否为<A,○>的自同构,为什么?